AI SEO 2026: So rankst du in ChatGPT, Claude und Perplexity

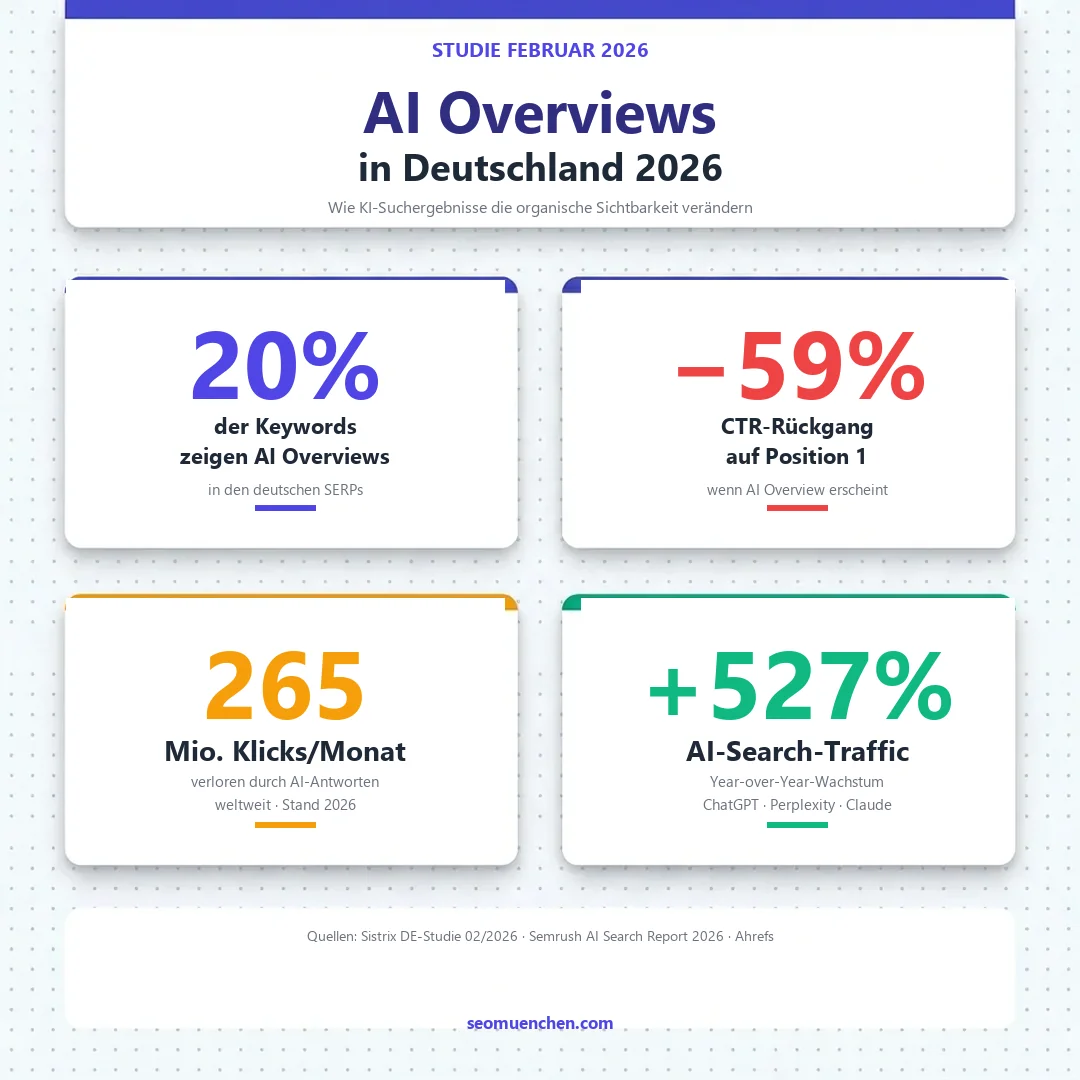

Organische Klicks. Pro Monat. Weg. Das ist die Zahl, die Sistrix in seiner Studie vom Februar 2026 für den deutschen Markt errechnet hat. Klicks, die durch AI Overviews aus den klassischen Suchergebnissen verschwunden sind.

Wikipedia allein verliert laut derselben Erhebung rund 31,6 Millionen Klicks pro Monat. Position 1 büßt bei einer aktiven AI Overview im Schnitt 59 Prozent ihrer Klickrate ein.

Wenn du als KMU-Inhaberin oder Marketing-Verantwortlicher in einem mittelständischen Unternehmen sitzt, ist das keine abstrakte Statistik mehr. Das ist dein Traffic, deine Leads, dein Umsatz. Und es ist der Grund, warum AI SEO 2026 keine Spielerei mehr ist, sondern Pflicht.

Dieser Artikel ist eine ehrliche Tutorial-Anleitung für KMU und Mittelstand. Keine Enterprise-Theorie, keine Buzzword-Show. Du lernst, was AI SEO konkret bedeutet, welche Hebel du selbst bedienen kannst und wo die Grenzen liegen. Mit Daten, Code-Snippets und einer realistischen Roadmap. Wenn du nach diesem Artikel die ersten drei Schritte umsetzt, bist du weiter als 90 Prozent deiner Wettbewerber.

Was ist AI SEO eigentlich?

Bevor wir tiefer einsteigen, klären wir die Begriffe. Die Branche wirft mit Akronymen um sich, und nicht alle meinen dasselbe.

| Begriff | Bedeutung | Was es konkret meint |

|---|---|---|

| AI SEO | AI Search Engine Optimization | Sammelbegriff für alle Optimierungen rund um KI-Suchsysteme |

| GEO | Generative Engine Optimization | Optimierung für generative Suchmaschinen (ChatGPT, Perplexity, AI Overviews) |

| AEO | Answer Engine Optimization | Optimierung für direkte Antworten, überschneidet sich stark mit GEO |

| LLMO | Large Language Model Optimization | Optimierung der Sichtbarkeit in LLM-Antworten ohne Live-Search |

| SGE | Search Generative Experience | Googles ursprünglicher Name für AI Overviews (mittlerweile veraltet) |

In der Praxis benutzen die meisten "AI SEO" und "GEO" synonym. GEO ist der etwas spezifischere Begriff, AI SEO der breitere. Wir verwenden beide in diesem Artikel, gemeint ist immer dasselbe Ziel: in den Antworten der KI-Systeme aufzutauchen, zitiert zu werden und idealerweise einen Klick zu generieren.

Wichtig zu verstehen: AI SEO ersetzt klassisches SEO nicht. Es erweitert es. Eine Seite, die in der klassischen Google-Suche nicht crawlbar ist, wird auch in AI Overviews nicht zitiert. Eine Seite ohne Backlinks und Autorität schafft es selten in die Quellen-Liste von Perplexity. Die Grundlagen bleiben, die Disziplin obendrauf ist neu.

Stand 2026: Wo stehen wir gerade?

Schauen wir auf die nüchternen Zahlen. Stand Frühjahr 2026 sieht der deutsche Markt so aus.

AI Overviews in Deutschland: Live ausgerollt seit dem 26. März 2025. Laut Sistrix zeigen aktuell rund 20 Prozent aller analysierten deutschen Keywords eine AI Overview. Im Health-Sektor sind es bereits 82 Prozent, wer dort Inhalte hat, kommt an AIO nicht vorbei.

ChatGPT Search: Verfügbar seit Ende 2024, mittlerweile ohne ChatGPT-Plus-Pflicht für die Basisfunktion. Nutzt im Hintergrund den Bing-Index, ein Punkt auf den wir später zurückkommen.

Marktanteile bei generativen KI-Tools (Statcounter, März 2026, weltweit):

| Plattform | Marktanteil |

|---|---|

| ChatGPT | 71,13 % |

| Perplexity | 11,76 % |

| Gemini | 7,68 % |

| Copilot | 5,85 % |

| Claude | 3,57 % |

Klassischer Such-Markt Deutschland (Statcounter, März 2026):

| Suchmaschine | Marktanteil DE |

|---|---|

| 80,05 % | |

| Bing | 9,99 % |

| Sonstige | 9,96 % |

Was bedeutet das praktisch? Google bleibt mit 80 Prozent dominant, aber innerhalb der Google-SERP frisst die AI Overview die Klicks. Und ChatGPT ist bei den KI-Tools so dominant, dass eine Optimierung für ChatGPT etwa 70 Prozent des KI-Suchmarkts abdeckt. Perplexity und Gemini sind die zweite Liga, aber relevant genug um sie nicht zu ignorieren.

Was die AI-Welle für deine Klicks bedeutet

Hier wird es interessant und überraschend. Die KI-Welle ist nicht nur Bedrohung. Sie verschiebt die Spielregeln.

Die Verlust-Seite (Sistrix-Studie 02/2026)

- Position 1 verliert bei aktiver AI Overview rund 59 Prozent CTR

- 265 Millionen organische Klicks pro Monat verloren in Deutschland

- Wikipedia: minus 31,6 Millionen Klicks pro Monat

- Health-Portale teilweise minus 30 Prozent organischer Traffic

Die Chance-Seite (Semrush/Adobe Analytics, Conductor 2026)

- AI-Visitor sind im Schnitt 4,4-mal wertvoller als organische Visitor

- 27 Prozent niedrigere Bounce Rate

- 38 Prozent längere Sessions

- Plus 76,7 Prozent Time-on-Site

- Conversion-Rate teilweise bei 18 Prozent (B2B-Sample)

Die Logik dahinter ist nüchtern: Wer durch eine AI Overview oder eine ChatGPT-Antwort auf deine Seite kommt, hat seine Frage bereits präzisiert. Die KI hat vorgefiltert. Was bei dir landet, ist Bottom-of-Funnel-Traffic mit hoher Kaufabsicht.

Klassischer Visitor vs. AI Visitor im Vergleich:

| Metrik | Klassischer Organic Visitor | AI Visitor |

|---|---|---|

| Bounce Rate | Baseline | −27 % |

| Session-Dauer | Baseline | +38 % |

| Time-on-Site | Baseline | +76,7 % |

| Conversion-Rate | 1 bis 3 % typisch | bis zu 18 % (Spitze) |

| Qualifizierungsgrad | mittel | hoch, KI hat vorgefiltert |

Die ehrliche Lesart: Du verlierst Quantität, gewinnst Qualität. Und genau deshalb lohnt sich AI SEO. Nicht weil du Angst vor dem Ende der klassischen Suche haben musst, sondern weil der KI-Klick schlicht der bessere Klick ist.

Wie funktioniert AI Search wirklich?

Um sinnvoll zu optimieren, musst du verstehen wie diese Systeme tatsächlich Antworten generieren. Es gibt drei Grund-Architekturen.

1. Trainings-basiert (Modell-Wissen)

Das LLM antwortet aus dem, was es während des Trainings gelernt hat. Beispiel: Claude im Standard-Modus ohne Web-Suche, Llama-only-Anwendungen. Hier zählt, ob dein Content im Trainingsdatensatz vorkam und ob er als zitierwürdig erkannt wurde. Optimierung ist hier langfristig und indirekt, über Brand-Präsenz, Wikipedia, hochwertige Drittquellen.

2. Such-basiert (RAG, Retrieval Augmented Generation)

Das System macht eine Live-Suche, holt sich aktuelle Quellen und generiert dann die Antwort darauf. Beispiele: Google AI Overviews, Perplexity. Hier ist die Optimierung nah am klassischen SEO, du musst crawlbar, indexiert und strukturiert sein.

3. Hybrid

Das System nutzt Modell-Wissen, ergänzt durch Live-Suche bei aktuellen oder spezifischen Anfragen. Beispiele: Gemini, ChatGPT mit aktivierter Search-Funktion. Das ist mittlerweile der Standard für die meisten Consumer-Anwendungen.

Was bedeutet das für deine SEO-Strategie?

| Engine-Typ | SEO-Fokus |

|---|---|

| Trainings-basiert | Brand-Building, Wikipedia, hochautoritative Drittnennungen |

| Such-basiert (RAG) | Klassisches SEO, Crawlability, strukturierte Antworten, Schema |

| Hybrid | Beides parallel, kein Entweder-oder |

Die gute Nachricht: Wenn du für RAG-Systeme optimierst, ziehst du oft auch positive Effekte für die Trainings-Komponente nach. Hochwertiger, gut strukturierter Content wird sowohl live abgerufen als auch in zukünftige Trainingssätze aufgenommen.

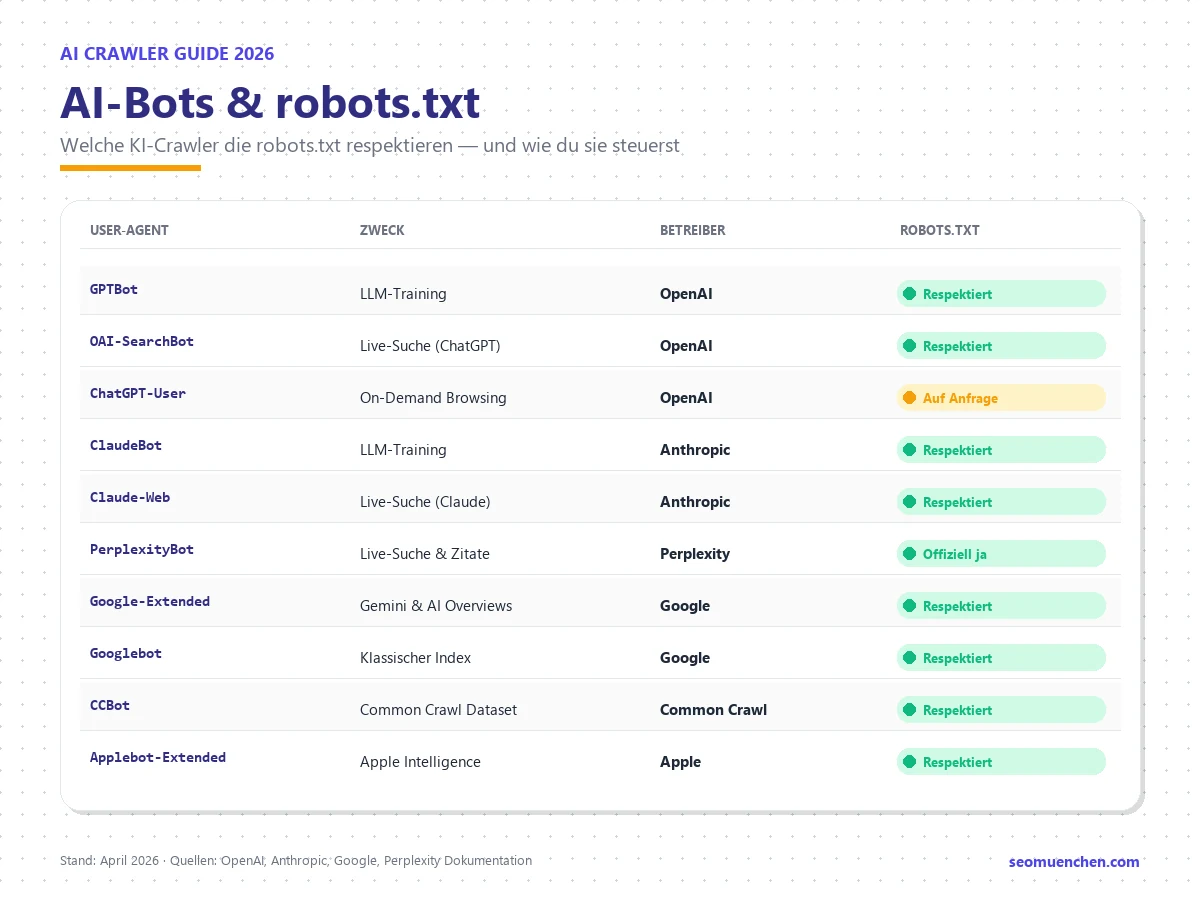

Die wichtigsten AI-Crawler im Überblick

Wer auf deinen Server zugreift, hat einen Namen. Hier sind die Bots die du 2026 kennen solltest.

| Bot | Betreiber | Zweck | robots.txt |

|---|---|---|---|

| GPTBot | OpenAI | Training für GPT-Modelle | respektiert |

| OAI-SearchBot | OpenAI | ChatGPT Search Live-Index | respektiert |

| ChatGPT-User | OpenAI | On-demand Browsing | respektiert |

| ClaudeBot | Anthropic | Training für Claude | respektiert |

| Claude-User | Anthropic | Live-Browsing in Claude-Sessions | respektiert |

| PerplexityBot | Perplexity | Index-Aufbau | respektiert |

| Perplexity-User | Perplexity | User-getriggertes Browsing | umstritten (Heise 2024) |

| Google-Extended | Gemini-Training und AI Overviews | respektiert | |

| Googlebot | Klassische Suche und AIO-Quellbasis | respektiert | |

| CCBot | Common Crawl | Open-Source-Crawl-Datensätze | respektiert |

| Applebot-Extended | Apple | Apple Intelligence Training | respektiert |

Hinweis zu Perplexity-User: Heise hat 2024 dokumentiert, dass Perplexity in bestimmten Konstellationen robots.txt-Direktiven für User-Browsing-Anfragen umgangen hat. Perplexity hat danach Anpassungen vorgenommen. Wenn dir das wichtig ist, kannst du Perplexity-User aktiv via Web Application Firewall blockieren, robots.txt allein reicht hier nicht zwingend.

robots.txt für AI-Bots: drei Strategien

Deine robots.txt ist der erste und billigste Hebel. Drei sinnvolle Ausgangspunkte:

Strategie 1: Maximal offen (Empfehlung für die meisten KMU)

# robots.txt User-agent: * Allow: / Sitemap: https://example.de/sitemap.xml

Alle Bots dürfen alles. Kein KMU mit normalem Content-Marketing hat einen guten Grund AI-Bots auszusperren. Du willst zitiert werden, du willst in den Trainingssätzen landen, du willst Sichtbarkeit. Diese Strategie maximiert das.

Strategie 2: Selektiv (Training blockieren, Live-Search erlauben)

# Training-Bots blockieren User-agent: GPTBot Disallow: / User-agent: ClaudeBot Disallow: / User-agent: Google-Extended Disallow: / User-agent: CCBot Disallow: / # Live-Search-Bots erlauben User-agent: OAI-SearchBot Allow: / User-agent: PerplexityBot Allow: / User-agent: * Allow: / Sitemap: https://example.de/sitemap.xml

Sinnvoll wenn du Original-Content produzierst der nicht in fremde Modelle einfließen soll, du aber trotzdem in Live-Antworten zitiert werden willst. Verlage, Forschung, Premium-Publisher.

Strategie 3: Restriktiv (Premium-/News-Content)

User-agent: GPTBot Disallow: / User-agent: ClaudeBot Disallow: / User-agent: CCBot Disallow: / User-agent: Google-Extended Disallow: / User-agent: Applebot-Extended Disallow: / User-agent: * Allow: / Sitemap: https://example.de/sitemap.xml

Hier blockierst du systematisch das KI-Training, während klassische Suchmaschinen weiter crawlen dürfen. Das ist der Pfad, den große Verlagshäuser (FAZ, Spiegel, NYT) gewählt haben, verbunden mit Lizenzverhandlungen mit OpenAI und Co.

Content optimieren für AI-Antworten: die 6 wichtigsten Hebel

Jetzt zum Kern. Was macht Content KI-tauglich? Princeton hat 2024 in der vielzitierten "GEO"-Studie sieben Optimierungs-Methoden getestet. Drei davon haben sich als signifikant wirksam erwiesen, andere als neutral oder negativ. Hier die Erkenntnisse, übersetzt in konkrete Hebel.

1. Pyramid-Prinzip: Antwort zuerst

LLMs scannen den Anfang eines Textabschnitts auf eine direkte Antwort. Wer mit Aufwärm-Sätzen, Storytelling-Intros oder generischer Kontextualisierung startet, wird seltener zitiert. Erste 1-2 Sätze müssen die Antwort liefern. Begründung, Kontext, Beispiel kommen danach.

Beispiel, Frage: "Was kostet eine GmbH-Gründung in Deutschland?"

Schlecht: "Wer in Deutschland gründen möchte, steht vor vielen Fragen. Eine davon ist die nach den Kosten. In diesem Artikel beleuchten wir das Thema umfassend ..."

Gut: "Eine GmbH-Gründung kostet in Deutschland typischerweise zwischen 600 und 1.200 EUR, bei mindestens 25.000 EUR Stammkapital, davon 12.500 EUR Mindesteinzahlung. Hinzu kommen Notarkosten, Handelsregister-Eintrag und Beratungsgebühren."

2. Question-Answer-Format

H2-Überschriften als Fragen formulieren, der erste Satz darunter liefert die Antwort. Genau so wie es Google's Featured Snippets seit Jahren belohnen, und wie es LLMs lieben.

3. FAQ-Sektionen mit FAQPage-Schema

Jede Service-Seite und jeder Ratgeber-Artikel sollte eine FAQ-Sektion haben, mit echten Fragen die deine Zielgruppe stellt. Plus FAQPage-Schema im strukturierten Daten-Markup. Das ist der niedrigschwelligste Hebel mit dem höchsten Hebel-Effekt.

4. Listicles, Tabellen, Checklisten

Strukturierte Formate haben die höchste Extraction-Rate in LLM-Antworten. Eine durchnummerierte Liste mit klaren Punkten wird häufiger als Quelle herangezogen als ein Fließtext gleichen Inhalts. Tabellen sind das Top-Format für Vergleichs-Queries.

5. Statistiken mit Quellen

Princeton-Studie: Die Methode "Cite Sources", also das Einfügen von Statistiken mit Quellenangabe, erhöhte die Visibility für Position-5-Inhalte um plus 115,1 Prozent. LLMs gewichten zitierfähige Aussagen höher. Daraus folgt: Wenn du eine Behauptung aufstellst, hänge eine Zahl mit Quelle dran.

6. Originaldaten und eigene Studien

Das ist der Hebel mit dem stärksten langfristigen Effekt. LLMs können keine eigenen Daten erheben. Wenn du eine Branchen-Umfrage, eine Preisanalyse oder eine Performance-Studie veröffentlichst, wirst du zur Zitations-Quelle. Eine einzige gute Studie pro Jahr kann mehr GEO-Wirkung haben als 50 generische Blog-Artikel.

Technische Hebel: was muss serverseitig stimmen?

Content allein reicht nicht. Wenn die Maschine deinen Content nicht sauber lesen kann, ist alle Optimierung umsonst.

- robots.txt wie oben besprochen, maximal offen für die meisten KMU.

- Schema.org strukturierte Daten: FAQPage, HowTo, Article/BlogPosting, LocalBusiness (Pflicht für jedes Münchner KMU), Organization, Person (Author-Bio mit sameAs-Links zu LinkedIn, X), Product/Offer, Review/AggregateRating

- Crawlability: Server-Side-Rendering oder Pre-Rendering bei JavaScript-lastigen Seiten. Reine Client-Side-React-Apps sind für AI-Crawler oft unsichtbar. TTFB unter 200 ms anstreben. Saubere HTML-Semantik (h1, h2, h3, p, ul, table)

- XML-Sitemap und IndexNow: XML-Sitemap aktuell halten. Zusätzlich IndexNow implementieren, das Protokoll wird von Bing und damit indirekt von ChatGPT Search genutzt

- Bing Webmaster Tools registrieren: Das ist der unterschätzteste Hebel überhaupt. ChatGPT Search nutzt im Hintergrund den Bing-Index. Wenn du nicht in Bing indexiert bist, bist du in ChatGPT Search praktisch unsichtbar. Registrierung ist kostenlos und dauert 15 Minuten. Mach das heute.

- HTTPS, Mobile-First, Core Web Vitals: Die klassischen Hygiene-Faktoren bleiben. Eine langsame, unsichere oder mobile-broken Site fliegt aus den Quellen-Listen. Mehr Details in unserer Technisches-SEO-Leistung.

Brand-Hebel: warum deine Marke außerhalb deiner Website wichtig ist

Hier wird AI SEO zum Marken-Marketing. LLMs ziehen ihre "Meinung" über dein Unternehmen aus tausenden externen Quellen, nicht primär aus deiner eigenen Website. Sieben Hebel die zählen:

- Wikipedia-Eintrag: die mit Abstand häufigste Citation-Quelle in AI Overviews und ChatGPT.

- Wikidata-Eintrag: niedrigere Hürde als Wikipedia, ähnlich wichtig für die Entity-Verknüpfung.

- Konsistente NAP-Daten (Name, Address, Phone) über LinkedIn, Crunchbase, Google Business Profile, OpenStreetMap, Branchenbücher.

- Echte Reviews: Google Business, Trustpilot, ProvenExpert, Branchenportale. ChatGPT Search zieht für lokale Empfehlungs-Queries fast immer Google-Maps-Reviews.

- YouTube-Kanal: eine eigene Source-Kategorie. LLMs zitieren YouTube-Videos mittlerweile aktiv, vor allem für How-to-Queries.

- Reddit/Quora-Präsenz: Reddit wird seit der OpenAI-Reddit-Kooperation 2024 überproportional häufig in ChatGPT-Antworten zitiert. Authentische Antworten in fachrelevanten Subreddits zahlen direkt auf deine Brand-KI-Sichtbarkeit ein.

- Vergleichsportale-Listings: Capterra, OMR Reviews, G2, Trusted Shops, je nach Branche.

Faustregel: Du baust nicht für deine Website, du baust für dein Entity-Profil im Web. Je konsistenter und vielfältiger deine Brand außerhalb deiner Domain auftaucht, desto eher empfiehlt dich die KI.

llms.txt: Hype oder Pflicht?

Kurze Einordnung, weil es ein häufiges Missverständnis gibt.

Was ist llms.txt? Eine vorgeschlagene Spezifikation für eine Markdown-Datei im Root-Verzeichnis, die LLMs eine kuratierte Übersicht deiner wichtigsten Inhalte gibt, vergleichbar einer Sitemap aber für KI-Konsum optimiert.

Wer hat es vorgeschlagen? Jeremy Howard (Mitgründer fast.ai) im September 2024. Nicht Anthropic, das wird in der deutschen Berichterstattung immer wieder falsch dargestellt. Es ist ein Community-Vorschlag, kein offizieller Standard.

Aktueller Status (April 2026): Keine große AI-Plattform hat offiziell bestätigt llms.txt zu nutzen. John Mueller von Google hat sich öffentlich skeptisch geäußert. OpenAI und Anthropic haben sich bisher nicht dazu positioniert. Es gibt anekdotische Berichte über bessere Ergebnisse, aber keine harten Daten.

Empfehlung: Aufwand minimal (15 Minuten), Schaden null. Mach es, aber erwarte keinen Game-Changer. Es ist ein "Nice-to-have" auf Position 14 deiner Prioritätenliste, nicht Position 1.

Beispiel-llms.txt für ein Münchner Steuerbüro:

# Mein Münchner Steuerbüro

> Steuerberatungskanzlei in München-Schwabing, spezialisiert auf KMU,

> Selbstständige und Freiberufler in Bayern. Gegründet 2008.

## Hauptseiten

- [Leistungen](https://example.de/leistungen): Übersicht aller Steuerberatungs-Services

- [Über uns](https://example.de/ueber-uns): Team und Kanzleiprofil

- [Kontakt](https://example.de/kontakt): Termin vereinbaren

## Fachgebiete

- [Steuern für Gründer](https://example.de/leistungen/gruender): GmbH, UG, Einzelunternehmen

- [Jahresabschluss](https://example.de/leistungen/jahresabschluss): HGB-konform

- [Lohnbuchhaltung](https://example.de/leistungen/lohn): DATEV-zertifiziert

## Ratgeber & Blog

- [Steuern für Gründer 2026](https://example.de/blog/steuern-gruender-2026): Komplette Anleitung

- [Kleinunternehmerregelung](https://example.de/blog/kleinunternehmer): Wann sie sich lohnt

Die Datei legst du unter https://deine-domain.de/llms.txt ab. Mehr ist es nicht.

Lokal in München: wie funktioniert das?

Für KMU mit lokalem Geschäft, Steuerberater in der Maxvorstadt, Zahnarzt in Schwabing, Handwerksbetrieb in Pasing, gelten ein paar Spezifika.

ChatGPT-Search und lokale Queries

Wenn du in ChatGPT fragst "Bester Steuerberater in München für Selbstständige", zieht das System mehrere Quellen: Google-Maps-Reviews, Google Business Profile, Branchenbücher, Stadtportale. Die Antwort ist eine Aggregation. Wer in keiner dieser Quellen sauber repräsentiert ist, taucht auch nicht in der Empfehlung auf.

Münchner Branchenbücher und Plattformen

- muenchen.de (offizielles Stadtportal)

- IHK München und Oberbayern

- branchenbuch.muenchen.de

- Handwerkskammer München (für Handwerk)

- gelbeseiten.de

- 11880.com

- meinestadt.de/muenchen

Stadtteil-Erwähnungen

LLMs verstehen Münchner Geografie. "Zahnarzt in der Maxvorstadt" ist eine andere Query als "Zahnarzt München". Wer auf seiner Website Stadtteile, Straßen und lokale Wahrzeichen erwähnt (natürlich, nicht gestapelt), wird in stadtteil-spezifischen Queries besser gefunden.

LocalBusiness-Schema mit korrektem areaServed

{

"@context": "https://schema.org",

"@type": "LocalBusiness",

"name": "Steuerberatung Müller",

"address": {

"@type": "PostalAddress",

"streetAddress": "Schellingstraße 42",

"addressLocality": "München",

"postalCode": "80799",

"addressCountry": "DE"

},

"areaServed": [

{"@type": "City", "name": "München"},

{"@type": "AdministrativeArea", "name": "Oberbayern"},

{"@type": "AdministrativeArea", "name": "Bayern"}

],

"geo": {

"@type": "GeoCoordinates",

"latitude": 48.1521,

"longitude": 11.5800

}

}

Wer tiefer in lokale Optimierung einsteigen will, findet auf unserer Local-SEO-Service-Seite weitere Details, und in unserem Local SEO Guide die Selbstmach-Anleitung. Die hier genannten Punkte deckt jeder Münchner KMU-Inhaber selbst in einem Wochenende ab.

Wie misst du deine AI-Sichtbarkeit?

Ohne Messung kein Management. Drei Methoden, gestaffelt nach Aufwand.

Methode 1: Manuell (kostenlos, sofort startbar)

Erstelle eine Liste mit 10-15 Test-Queries:

- 3 Brand-Queries ("Was ist [dein Unternehmen]?")

- 5-7 Service-Queries ("Bester [dein Service] in München")

- 2-3 Long-Tail-Informationsqueries ("Wie funktioniert [dein Thema]?")

Teste diese Queries einmal pro Monat in ChatGPT, Perplexity, Gemini und Google AI Overview. Notiere: Wirst du erwähnt? Bist du in den Quellen verlinkt? In welcher Reihenfolge? Mit welcher Beschreibung?

Methode 2: Spezialisierte Tools (kostenpflichtig)

| Tool | Schwerpunkt | Preisniveau |

|---|---|---|

| Profound | KI-Citation-Tracking, Enterprise | hoch |

| Otterly.AI | KI-Brand-Monitoring | mittel |

| Peec AI | GEO-Analytics | mittel |

| AthenaHQ | KI-Visibility-Dashboard | mittel |

| Semrush AI Toolkit | Integration in bestehende SEO-Suite | im Semrush-Abo |

| Ahrefs Brand Radar | KI-Mentions-Tracking | im Ahrefs-Abo |

Methode 3: GSC und GA4

- Google Search Console zeigt seit 2026 zunehmend AIO-Impressions als eigenes Segment

- GA4 über Custom-Channel-Group: AI-Referral-Traffic isolieren. Source-Liste: chatgpt.com, perplexity.ai, gemini.google.com, copilot.microsoft.com, claude.ai

Die KPIs die wirklich zählen:

- Impressions in AI Overviews (GSC)

- Anzahl Citations in ChatGPT/Perplexity (manuell oder Tool)

- AI-Referral-Sessions (GA4)

- Engagement AI-Traffic vs. Organic-Traffic (Bounce, Session-Dauer, Conversions)

Realistic Roadmap: was wann passiert

Erwartungs-Management ist die unterschätzte Disziplin. Hier eine realistische Timeline für ein KMU das bei null startet:

- Hygiene robots.txt prüfen und auf "maximal offen" stellen. Schema-Audit der Top-10-Seiten. Content-Format-Check. Bing Webmaster Tools registrieren. 15 Test-Queries als Baseline dokumentieren.

- Foundation FAQ-Sektionen auf Service-Seiten ergänzen, FAQPage-Schema implementieren. llms.txt erstellen und deployen. Google Business Profile auf 100 Prozent Vollständigkeit bringen. LocalBusiness-Schema mit areaServed implementieren. Erste 5 echte Reviews aktiv einsammeln.

- Sichtbarkeit aufbauen Erste Citations in ChatGPT/Perplexity sichtbar. Brand-Mentions auf Drittseiten gezielt aufbauen. 1-2 Reddit/Quora-Antworten pro Woche in fachrelevanten Threads. YouTube-Kanal starten. Erste lokale Pressemitteilung an Münchner Medien.

- Konsolidieren Wikidata-Eintrag erstellen. Bei ausreichender Außenwahrnehmung: Wikipedia-Anlauf starten. Erste Originaldaten/Studie konzipieren und veröffentlichen. Signifikanter AI-Referral-Traffic-Anstieg messbar. KPIs etablieren und monatliches Reporting.

- Stabilisieren Stabile AI-Inclusion in Service-Queries. Messbare Conversions aus AI-Traffic. Brand-Profil im Web breit verankert (Wikipedia, Wikidata, Reviews, YouTube, Reddit). Skalierung der wirksamen Hebel.

Wichtige Erwartungs-Anker: AI SEO ist langsamer als klassisches SEO in den ersten 60 Tagen, und schneller danach. Die Algorithmen lernen aus deiner Brand-Konsistenz. Die ersten 6-8 Wochen siehst du oft fast nichts. Dann kippt es.

Kosten: was kostet AI SEO 2026 wirklich?

Ehrliche Zahlen, ohne Schönreden.

- Selbst gemacht (DIY): 0 bis 500 EUR pro Monat. ChatGPT Plus, evtl. Otterly.AI, Schema-Validatoren kostenlos. Grenze: deine Zeit und dein technisches Knowhow.

- Freelancer: 800 bis 2.500 EUR pro Monat. Sinnvoll für KMU mit klarem Fokus. Risiko: Qualität schwankt stark, kaum jemand hat 2026 schon belastbare GEO-Erfahrung.

- Agentur in Deutschland/München: 1.500 bis 8.000 EUR pro Monat. Für KMU mit Ambitionen typisch im Bereich 990 bis 2.990 EUR pro Monat (siehe unsere Pakete-Übersicht). Für Mid-Market kann der Aufwand auch höher liegen, vor allem wenn Original-Content-Produktion und PR mit drin sind.

Faustregel für 2026: 20 bis 25 Prozent deines bestehenden SEO-Budgets sollten in GEO-spezifische Maßnahmen fließen. Wenn du heute 4.000 EUR pro Monat für SEO ausgibst, wäre eine sinnvolle Allokation 800 bis 1.000 EUR pro Monat AI SEO obendrauf, oder als Re-Allokation aus weniger wirksamen klassischen Maßnahmen.

Detaillierte Pakete und Preise findest du auf unserer Preisseite, und wenn du AI SEO als gemanagten Service willst, beschreibt das unsere GEO-Agentur-Seite im Detail.

Häufige Fragen zu AI SEO

Fazit: wie fängst du an?

Kein Marathon-Plan, keine 80-Punkte-Checkliste. Drei Schritte die dich in 48 Stunden weiter bringen als die meisten deiner Wettbewerber:

Quick-Start in 3 Schritten

- robots.txt prüfen, 5 Minuten. Öffne

deine-domain.de/robots.txt. Wenn dort GPTBot, ClaudeBot oder Google-Extended blockiert sind, frag dich warum. Für 95 Prozent der KMU lautet die Antwort: maximal offen. - FAQPage-Schema auf Top-3-Seiten, 1 Stunde. Nimm deine drei wichtigsten Service-Seiten. Ergänze eine FAQ-Sektion mit 5-8 echten Kunden-Fragen. Implementiere FAQPage-Schema. Höchstes Verhältnis von Aufwand zu KI-Sichtbarkeit.

- Brand-Audit, 1 Tag. Liste auf wo deine Marke außerhalb deiner Domain auftaucht: Google Business, Wikipedia, Wikidata, LinkedIn, Crunchbase, YouTube, Reddit, Branchenportale, lokale Medien. Wo bist du nicht? Wo sind die NAP-Daten inkonsistent? Wo fehlen echte Reviews? Diese Liste ist deine Roadmap für die nächsten sechs Monate.

Mehr braucht es zum Start nicht.

Du willst AI SEO mit professioneller Begleitung?

Wir machen ein kostenloses Erstgespräch ohne Bindung. 30 Minuten, in denen wir deinen Status quo anschauen, die wichtigsten Lücken benennen und dir zeigen, was selbst machbar ist und wo Begleitung sich lohnt.

Kostenloses Erstgespräch sichernWenn dir das alles zu komplex wird oder du keine internen Kapazitäten hast, übernehmen wir das gerne für dich. Mehr Details findest du auf unserer GEO-Agentur-Seite. Wer zuerst die technische Basis sicherstellen will, ist auf unserer Technisches-SEO-Seite richtig.